Differential Privacy: Apple erklärt, wie iOS und macOS die Privatsphäre schützen

Starke smarte Funktionen und ein starker Datenschutz, das ist ein Gegensatz, den Apple mit einem speziellen Verfahren auflösen möchte. Wie sein „Differential Privacy“-Algorithmus arbeitet, erklären nun Apple-Entwickler im Journal für MachineLearning-Themen, den das Unternehmen seit einigen Monaten betreibt.

Apple wollte offener werden, was die Prozesse seiner Entwicklungsabteilungen betrifft, vor allem im Bereich des maschinellen Lernens und AI, wo es zuletzt drohte ins Hintertreffen zu geraten, nachdem sich Forscher beklagten, nicht mehr als Teil der wissenschaftlichen Gemeinde arbeiten zu können und das Unternehmen verlassen hatten. Nun wurde ein neuer Eintrag in Apples MachineLearning-Journal veröffentlicht. Er befasst sich mit der Funktionsweise von „Differential Privacy“. Mit diesem Verfahren möchte Apple Siri und andere Assistive Funktionen smarter und schlauer machen, damit sie mit Alexa und Googles Assistant konkurrieren können und gleichzeitig die hohen Ansprüche, die es selbst und seine Nutzer an Apple stellen,, hochhalten. Diese Beiträge werden eher für ein Fachpublikum geschrieben.

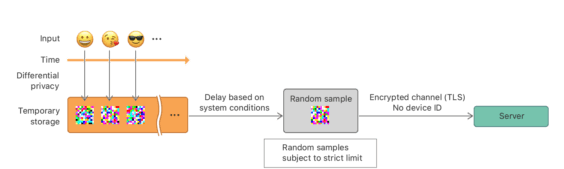

Auswertung von Emoji-Nutzung – Apple

Apple beschreibt im jüngsten Artikel etwa, wie es aus der Nutzung von Emojis lernen kann, ohne die Anonymität der Nutzer aufzuweichen. So werden Daten über Aktionen des Nutzers zunächst lokal gespeichert. Später werden dann zufällige Stichproben ausgewählt, die anonymisierten mit Apple geteilt werden. Durch die Speicherung der Daten lokal erhalten AppleServer nie Rohdaten, was die Privatsphäre des Einzelnen stärkt. Ohnehin werden nur dann Daten gesammelt, wenn der Nutzer dies in den Tracking-Einstellungen erlaubt. Diese Einstellung wird auch beim ersten Einrichten eines iPhones oder Macs abgefragt. Das „Differential Privacy“-Feature gilt als vielversprechender Schritt hin zu mehr Privatsphäre am Smartphone, hat aber auch Kritiker. So bemängelten zuletzt Forscher, das statistische Grundrauschen, eben die Zufälligkeit der Datenauswahl und die Anonymisierung der Nutzerdaten, sei nicht zufällig genug und werde von Apple nicht transparent genug erklärt.

-----

Willst du keine News mehr verpassen? Dann folge uns auf Twitter oder werde Fan auf Facebook. Du kannst natürlich in Ergänzung unsere iPhone und iPad-App mit Push-Benachrichtigungen hier kostenlos laden.

Oder willst du mit Gleichgesinnten über die neuesten Produkte diskutieren? Dann besuch unser Forum!

4 Kommentare zu dem Artikel "Differential Privacy: Apple erklärt, wie iOS und macOS die Privatsphäre schützen"

4 Kommentare zu dem Artikel "Differential Privacy: Apple erklärt, wie iOS und macOS die Privatsphäre schützen"

-

inuli 7. Dezember 2017 um 19:01 Uhr ·Ich teile den Standpunkt der Kritiker, und gehe noch darüber hinaus: die Privatsphäre des Einzelnen ist nur dadurch zu stärken, daß KEINERLEI Daten erhoben werden. Was Apple uns hier weiszumachen versucht, ist das Essen desjenigen Kuchens, der behalten werden soll – also Quatsch mit Soße!! 👎

iLike 1

iLike 1 -

inuli 7. Dezember 2017 um 19:09 Uhr ·Ich teile den Standpunkt der Kritiker, und gehe noch darüber hinaus: die Privatsphäre des Einzlenen kann nur durch Verzicht auf Datenerhebung gestärkt werden. Was Apple uns mit der sogenannten Differential Privacy weismachen möchte, ist offensichtlich der Versuch, den Kuchen zu behalten, der gegessen werden soll!! 👎

iLike 0

iLike 0 -

Tom 8. Dezember 2017 um 09:06 Uhr ·Tja, ohne Daten keine KI!

iLike 0

iLike 0 -

inuli 8. Dezember 2017 um 12:20 Uhr ·Wer benötigt KI (künstliche Intelligenz) wirklich?: die führerscheinlosen unter uns? Diejenigen, welche Betreuung (durch Maschinen) benötigen? Diejenigen, denen Gefahren, wie der gläserne Bürger, die Unterjochung der Menschen durch Maschinen (zugegeben, zur Zeit noch weit hergeholt, aber es gibt entsprechende Warnungen) legal, illegal, sch…-egal sind? Tja …

iLike 0

iLike 0

-